基于树的分类算法是机器学习中的经典方法之一,广泛应用于人工智能理论与算法软件开发中。这类算法通过构建树形结构对数据进行划分,实现高效的分类任务。

一、算法原理

基于树的分类算法的核心思想是递归地将数据集分割成更小的子集,直到每个子集中的样本属于同一类别或满足停止条件。主要包括以下步骤:

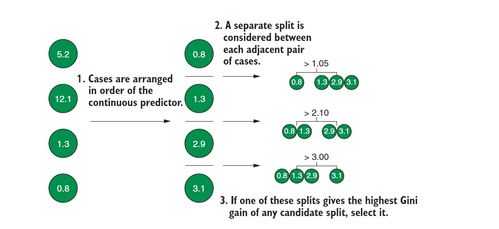

- 特征选择:选择最优特征作为节点进行分割,常用的指标包括信息增益(如ID3算法)、基尼不纯度(如CART算法)等。

- 节点分裂:根据选定的特征及其阈值将数据划分为不同的分支,使得子节点的纯度更高。

- 停止条件:当节点中的样本全部属于同一类别、没有更多特征可用,或达到预设的树深度时停止分裂。

- 剪枝处理:为防止过拟合,对生成的树进行剪枝,提升模型的泛化能力。

二、常见算法

- 决策树(Decision Tree):最基础的树模型,适用于分类和回归任务。

- 随机森林(Random Forest):通过集成多棵决策树,采用Bagging和随机特征选择提升模型的稳定性和准确率。

- 梯度提升树(Gradient Boosting Trees):如XGBoost、LightGBM等,通过迭代优化损失函数,逐步减少残差,实现高性能分类。

三、算法实现

在实际软件开发中,基于树的分类算法可通过以下步骤实现:

- 数据预处理:包括数据清洗、缺失值处理、特征编码等,确保输入数据符合算法要求。

- 模型训练:使用训练数据集构建树模型,通过递归或迭代方式生成决策规则。

- 模型评估:采用交叉验证、准确率、精确率、召回率等指标评估模型性能。

- 模型优化:通过超参数调优(如树深度、叶子节点数)和特征工程提升模型效果。

四、应用场景

基于树的分类算法在人工智能领域具有广泛应用,如金融风控、医疗诊断、推荐系统等。其优势在于可解释性强、易于实现,且能处理非线性关系。

基于树的分类算法是机器学习中不可或缺的工具,掌握其原理与实现方法对于开发高效、可靠的人工智能系统至关重要。